Facebook crea un ‘Facebook paralelo’ para detectar comportamiento dañino de usuarios

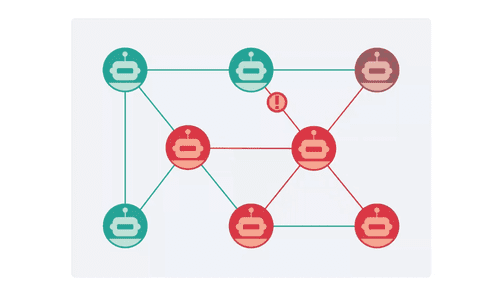

El gigante tecnológico ha lanzado una versión simulada de Facebook lleno de bots diseñados para imitar el mal comportamiento humano en redes sociales.

- Evita que tu celular se caliente demasiado con 4 medidas inmediatas para controlar el cargador

- Chefs profesionales revelan el secreto de las lentejas perfectas: 3 ingredientes transforman su sabor por completo

En un esfuerzo por saber cómo identificar y detener el comportamiento dañino en redes sociales, los ingenieros de Facebook han desarrollado un simulador a escala de la red social para detectar oportunamente a usuarios problemáticos, como los que envían spam, estafan a otras personas o venden armas y drogas.

“El comportamiento de las personas evoluciona y se adapta con el tiempo y es diferente de una geografía a la siguiente, lo que hace que sea difícil anticipar todas las formas en que un individuo o una comunidad entera podrían responder incluso a un pequeño cambio en su entorno”, explicó la compañía en un comunicado.

TE RECOMENDAMOS

TEMU VS. ALIEXPRESS: ¡AQUÍ ESTÁN LOS MEJORES PRECIOS! | TECHMOOD

La versión paralela de Facebook ha sido habilitada para la Web-Enabled Simulation (WES), la cual utiliza el aprendizaje automático para entrenar miles de bots que simulan de “manera realista” los comportamientos de las personas en redes sociales. Estos pueden enviar mensajes, comentar o hacer publicaciones, mandar solicitudes de amistad o interactuar entre sí.

En este caso, se diseñaron un grupo de ‘bots buenos’ para actuar como objetivos y otros grupo diseñado para simular el mal comportamiento humano. De esta forma, los ingenieros de Facebook pueden estudiar su comportamiento y descubrir nuevas formas sobre cómo detenerlos.

Los ingenieros experimentaron con diferentes formas de contrarrestar el comportamiento de los ‘bots malos’ introduciendo varias restricciones, como limitar el número de mensajes privados y publicaciones que ellos podían enviar por minuto, con el objetivo de observar cómo esto afectaba su comportamiento.

“Aplicamos ‘reducciones de velocidad’ a las acciones y observaciones que pueden realizar nuestros bots, y exploramos tan rápidamente los posibles cambios que podríamos hacer en los productos para inhibir el comportamiento dañino sin dañar el comportamiento normal”, detalló Mark Harman, ingeniero a cargo de la investigación.

“En este momento, el enfoque principal es entrenar a los bots para que imiten cosas que sabemos que suceden en la plataforma. Pero en teoría y en la práctica, los bots pueden hacer cosas que no hemos visto antes”, señaló Harman. “Eso es algo que realmente queremos, porque en última instancia queremos adelantarnos al mal comportamiento en lugar de jugar continuamente para ponernos al día”.

Recetas

Tallarines verdes peruanos: receta clásica deliciosa (VIDEO)

Cómo preparar un arroz con pollo tradicional riquísimo (VIDEO)

Sudado de pescado (VIDEO)

Escabeche de pollo receta: fácil y buenazo (VIDEO)

Ofertas

Cineplanet

CINEPLANET: 2 entradas 2D + 2 bebidas grandes + Pop corn gigante. Lunes a Domingo

PRECIO

S/ 47.90

Farenet

REVISION TECNICA VEHICULAR FARENET. Locales a elegir. Lunes a Domingo.

PRECIO

S/ 84.90

La Bistecca

ALMUERZO O CENA BUFFET + Postre + 1 Ice tea de Hierba luisa en sus 4 LOCALES

PRECIO

S/ 85.90

Cinemark

CINEMARK: Entrada 2D - opción a combo (Validación ONLINE o mostrando tu celular)

PRECIO

S/ 10.90