No te dejes engañar: así puedes identificar imágenes falsas generadas por IA

La inteligencia artificial ha avanzado a pasos agigantados, y con ella, la capacidad para crear imágenes falsas que son casi indistinguibles de las auténticas. Descubre cómo protegerte de las deepfakes más comunes.

La tecnología ha transformado muchos aspectos de nuestra vida cotidiana, desde cómo trabajamos hasta cómo consumimos información. Sin embargo, estos avances no están exentos de riesgos. Uno de los peligros más recientes es la creación de imágenes falsas mediante inteligencia artificial (IA), una técnica que ha revolucionado nuestra percepción de la realidad.

Las imágenes falsas creadas con IA, conocidas como deepfakes, han ganado popularidad debido a su capacidad para replicar la realidad con un nivel de detalle impresionante. Esta tecnología permite generar fotos y videos que imitan fielmente a personas, lugares y eventos, lo que genera dudas sobre su autenticidad. ¿Cómo podemos protegernos contra esta sofisticada forma de manipulación visual? En este sentido, es fundamental comprender qué son las deepfakes y aprender a identificar imágenes generadas por IA.

TE RECOMENDAMOS

TEMU VS. ALIEXPRESS: ¡AQUÍ ESTÁN LOS MEJORES PRECIOS! | TECHMOOD

¿Qué son las deepfakes?

El término 'deepfake' es una combinación de 'deep learning' (aprendizaje profundo) y 'fake' (falso), y se refiere a medios sintéticos que utilizan inteligencia artificial para crear contenido visual o auditivo falso. Esta tecnología emplea algoritmos avanzados de aprendizaje automático para analizar imágenes y videos reales, para luego generar representaciones falsas que pueden ser tan realistas como la fuente original.

PUEDES VER:¿La arepa es de Venezuela o Colombia? Inteligencia artificial pone fin a disputa gastronómica

Las deepfakes se popularizaron inicialmente en el ámbito del entretenimiento, pero su alcance se ha extendido más allá de ese contexto, lo que ha suscitado inquietud por sus potenciales implicaciones en la desinformación, el fraude y la privacidad. Los avances en la inteligencia artificial han facilitado que cualquier individuo con conocimientos básicos pueda generar estos archivos convincentes, lo que incrementa la probabilidad de que esta tecnología sea empleada con propósitos malintencionados.

¿Cómo identificar imágenes generadas por inteligencia artificial?

Reconocer una imagen falsa generada por IA puede ser un desafío, pero existen varios métodos y señales que pueden ayudarte a detectar manipulaciones:

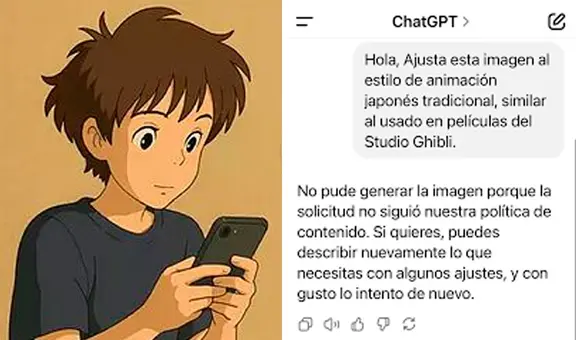

- Análisis de detalles inconsistentes: Las imágenes generadas por IA, especialmente aquellas que se crean rápidamente, a menudo presentan pequeños errores en detalles como sombras, reflejos, o proporciones anatómicas. Por ejemplo, las manos y los dedos pueden aparecer deformados o en posiciones inusuales, un indicio común en deepfakes mal elaborados.

Las manos y los dedos pueden aparecer deformados o en posiciones inusuales. Foto: Composición LR | NZZ.

- Análisis de la iluminación y textura: La IA puede tener dificultades para replicar correctamente la iluminación en una escena o la textura de ciertos materiales. Inconsistencias en la luz o en la textura de piel, cabello, o ropa pueden ser indicativos de una imagen generada artificialmente.

- Verificación de metadatos: Los archivos de imagen suelen contener metadatos que indican cuándo y dónde fueron capturados. Si estos datos faltan o parecen incoherentes, es posible que la imagen haya sido manipulada o generada de forma artificial.

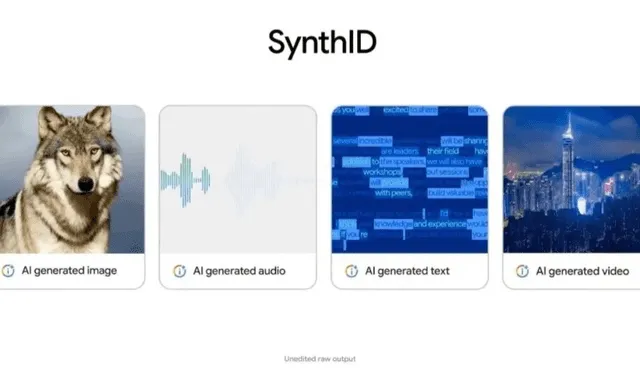

- Uso de herramientas de detección: Existen programas y extensiones para navegadores que analizan las imágenes y verifican su autenticidad. Estas herramientas comparan la imagen con bases de datos de imágenes conocidas para identificar posibles manipulaciones o si ha sido generada por IA. Por ejemplo, SynthID o AI or Not, ambas son herramientas creadas para detectar este tipo de contenido; sin embargo, sus resultados no son del todo infalibles.

SynthID, es una herramienta creada por Google para identificar contenidos producidos por la IA. Foto: Google DeepMind.

- Revisión del contexto: Las deepfakes suelen carecer de un contexto veraz. Es importante investigar el origen de la imagen, buscar versiones anteriores o similares, y contrastarlas con fuentes confiables. Si la imagen aparece de repente sin antecedentes claros, podría tratarse de una desinformación.