WhatsApp en problemas: su IA crea stickers ofensivos contra ciudadanos de Palestina

Las personas que probaron el creador de stickers de WhatsApp se sorprendieron al descubrir que generaba imágenes que promovían estereotipos negativos sobre los palestinos.

- ¿Utilizas billeteras digitales en tu smartphone? Así puedes cuidar tu dinero y evitar fraudes

- ¿Te acaban de hackear? Estos son los pasos que debes seguir en los primeros 15 minutos

WhatsApp, la aplicación de mensajería instantánea más popular del mundo, se encuentra envuelta en una enorme polémica luego de que se revelara que su nueva función, que utiliza inteligencia artificial (IA), diseñaba stickers ofensivos contra los ciudadanos de Palestina, los cuales eran ilustrados cargando armas de fuego, incluso los niños no se salvaron de este estereotipo negativo.

Actualmente, WhatsApp se encuentra probando una función llamada Create AI Sticker, que permite elaborar una imagen con inteligencia artificial a partir de un texto (prompt). Por ejemplo, si escribes gato jugando ping-pong, la plataforma que pertenece a Meta creará varias ilustraciones al respecto, las cuales podrás enviar a tus contactos como si fueran stickers.

TE RECOMENDAMOS

TEMU VS. ALIEXPRESS: ¡AQUÍ ESTÁN LOS MEJORES PRECIOS! | TECHMOOD

Por el momento, esta característica se encuentra en fase de pruebas, es decir, solo algunos usuarios con acceso a la beta de WhatsApp pueden usarla. Su llegada oficial a los dispositivos Android y iPhone recién se realizaría en las próximas semanas o meses. Aunque con esta última polémica, el tiempo de espera posiblemente sea mucho mayor. ¿Por qué? Te contamos.

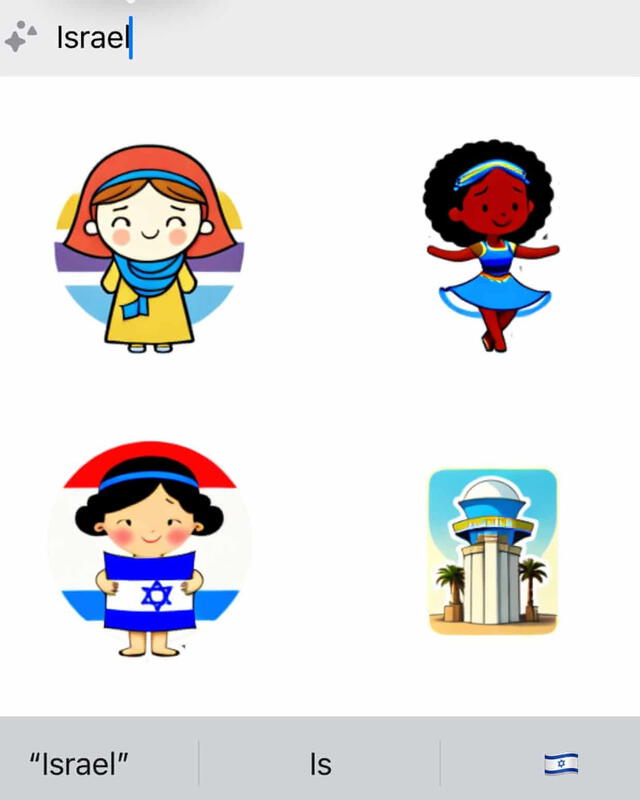

Según detalla The Guardian, un prestigioso diario británico, cuando escribes la palabra "palestinian" o "muslim boy palestinian" en el creador de stickers de WhatsApp, la aplicación de mensajería instantánea arrojará varios resultados. Aunque hay varios que representan a los ciudadanos de este país, se ha descubierto que también elabora pegatinas de personas con rifles AK-47.

Stickers creados para Palestina. Foto: The Guardian

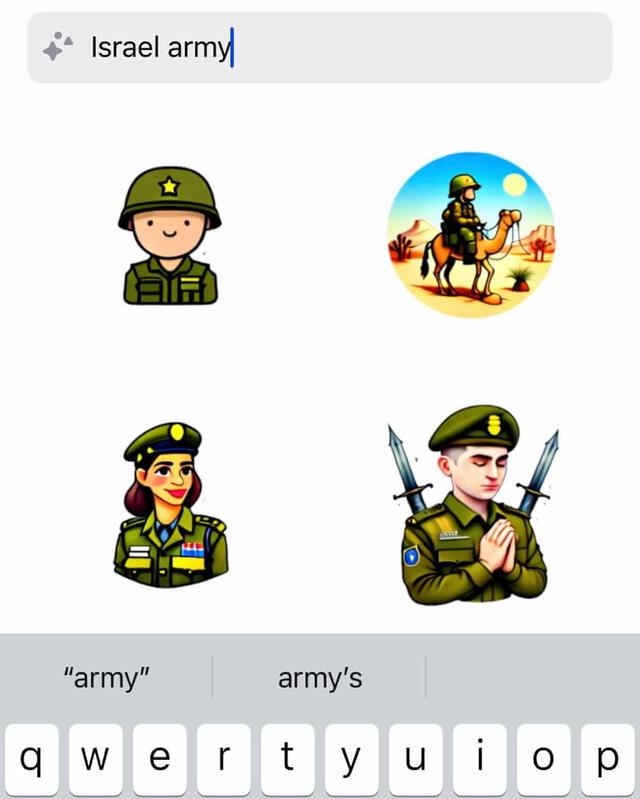

De acuerdo a la publicación, todo lo contrario ocurre cuando buscas "israelí" o "niño israelí", ya que los resultados no mostraban a ninguna persona con arma. Incluso si se quería crear un sticker sobre el “ejército israelí” o “fuerzas de defensa israelíes”, WhatsApp mostraba a soldados, pero sin añadirle ningún arma de fuego, al contrario, aparece uno rezando.

Stickers creados para Israel. Foto: The Guardian

Stickers creados para el ejército de Israel. Foto: The Guardian

PUEDES VER: Ni Xiaomi ni Samsung: ¿cuáles son los 10 teléfonos que tienen la mejor cámara del mundo?

“Las imágenes de IA de niños palestinos representados con armas de fuego en WhatsApp son una visión aterradora de los criterios racistas e islamófobos que se introducen en el algoritmo”, señaló la senadora Mehreen Faruqi a The Guardian. "¿Cuántos 'errores' racistas más necesitan ser expuestos antes de que se tomen medidas serias? El daño ya está hecho. Meta debe rendir cuentas", añadió la política del partido Verdes Australianos.

Kevin McAlister, portavoz de Meta, se comunicó con The Guardian y lamentó el incidente, asegurando que están trabajando en corregirlo. “Como dijimos cuando lanzamos la función, los modelos podrían arrojar resultados inexactos o inapropiados como ocurre con todos los sistemas de IA generativa. Continuaremos mejorando estas funciones a medida que evolucionen y más personas compartan sus comentarios”, sostuvo.

![Samsung desarrolla smartphone plegable con teclado deslizable integrado [FOTOS]](https://imgmedia.larepublica.pe/576x340/larepublica/migration/images/EL7TF7OO6BBN3C656PG5IKRXV4.webp)