¿Quién es Gary Marcus, profesor que llamaron 'loco' por su postura sobre IA en 2022? Su predicción era cierta

"Algo increíble está sucediendo en el mundo de la inteligencia artificial y no es del todo bueno", afirmó el también científico, autor y empresario estadounidense.

- China compra maíz de un país de Sudamérica por primera vez en más de 10 años y proyectan que exportación supere 40 millones de toneladas

- El aeropuerto sobre la cordillera de los Andes que un país de Sudamérica moderniza con más de US$30 millones y estará listo en 2027

En la última década, la inteligencia artificial (IA) se ha transformado y crecido con mucha fuerza. Incluso, esta es una realidad que aspira a revolucionar diversos aspectos de nuestra sociedad.

Sin embargo, son muchos los especialistas que advierten de sus posibles consecuencias. Hacen énfasis en la posibilidad de que esta se escape del control de los humanos.

TE RECOMENDAMOS

LO MEJOR DE LOS PROGRAMAS LR +

Este es el caso del profesor de la Universidad de Nueva York Gary Marcus, una de las principales voces en el debate sobre la IA en la actualidad.

PUEDES VER: “Criaron un monstruo”: mujer rusa irá a prisión por dejar carta en tumba de papás de Putin

El investigador argumenta que el lanzamiento de ChatGPT, el chatbot basado en IA, nos lleva al "momento Jurassic Park" de las máquinas, debido a la posibilidad de que la situación se salga de control y termine perjudicándonos.

"Algo increíble está sucediendo en el mundo de la inteligencia artificial y no es del todo bueno", predijo hace seis meses el también científico, autor y empresario estadounidense.

“Estos sistemas pueden ser muy destructivos”

En 2022, previo al lanzamiento de ChatGPT, Marcus escribió: "¿Quizás un chatbot lastimará a alguien tan profundamente que la persona se verá impulsada a terminar con su vida? (...) En 2023, podemos ver nuestro primer asesinato por un chatbot".

Tras esa afirmación, agregó: "Creo que estos sistemas pueden ser muy destructivos. Y parte de la razón del potencial de destrucción es que no son confiables. Estos programas pueden inventar algo y decirle [al usuario] que es un hecho. Y también pueden ser usados por personas para ese fin".

Su predicción ha sido relacionada con el fallecimiento de un hombre belga de unos treinta años ocurrido en marzo, luego de que, según se difundiera, había pasado seis semanas conversando de manera intensiva con un chatbot.

El sujeto se quitó la vida tras aislarse cada vez más de su familia y separándose del mundo real. "En el futuro inmediato, es fundamental identificar claramente la naturaleza de las responsabilidades que pueden haber llevado a este tipo de hechos", escribió tras el hecho el secretario de Estado belga de Digitalización, Mathieu Michel, en un comunicado de prensa.

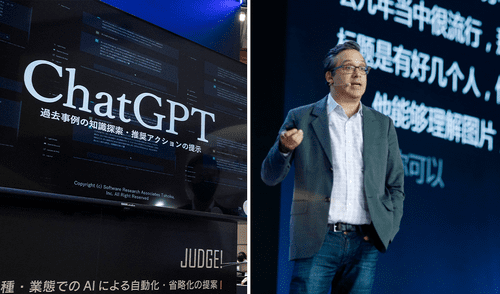

Gary Marcus en una conferencia TED el mes pasado. Foto: Gilberto Tadday/TED

¿Qué es lo que más le preocupa de la IA?

Pese a la reputación que ha ganado como uno de los escépticos más destacados de la industria, Marcus se autoproclama un amante de la IA. "Sus capacidades potenciales son revolucionarias", dice.

"En medicina, nos ayudará a comprender cómo funciona el cerebro y a desarrollar medicamentos para enfermedades que no hemos podido curar por nosotros mismos. Puede ayudarnos a lidiar con el cambio climático y también a hacer cosas como construir casas robóticas para cuidar a los ancianos. Si lo hacemos bien, a la larga, el cielo es el límite", dijo el profesor emérito de Psicología y Neurociencia.

Sin embargo, Marcus se ha mostrado preocupado por un hecho inquietante con respecto a esta tecnología.

Más que escenarios apocalípticos en los que las máquinas se rebelan contra los humanos, el profesor ha indicado que su principal preocupación es el peligro para la democracia, debido a la desinformación y las noticias falsas creadas por esta tecnología.

Para Marcus, "no tenemos ninguna garantía formal de que estos programas funcionen correctamente, incluso cuando hacen cálculos matemáticos".

PUEDES VER: Bukele asegura que El Salvador lleva un año sin homicidios, pero HRW califica esto como "engañoso"

A fines de marzo, se difundió la noticia de una persona que le pidió a ChatGPT que nombrara a académicos involucrados en acoso sexual.

La tecnología mencionó a un profesor de derecho estadounidense, Jonathan Turley. El programa dijo que este lanzó comentarios de tono sexual a una estudiante durante un viaje a Alaska y citó como evidencia un informe de 2018 del Washington Post.

Sin embargo, nada de eso había sucedido. Ni el informe, ni el viaje ni la acusación eran ciertas, según detalló BBC.

"Si no tomamos medidas, estamos cerca de entrar en un ambiente de posverdad", dijo el profesor.

"La combinación de deepfaking y modelos de lenguaje avanzado nos llevarán a un mundo donde los malos actores pueden inventar tanta información como quieran y cualquier narrativa que quieran, llena de referencias a estudios que nunca sucedieron con datos convincentes que no existen, con referencias falsas”, sentenció.

China compra maíz de un país de Sudamérica por primera vez en más de 10 años y proyectan que exportación supere 40 millones de toneladas

Delcy Rodríguez solicitó cerca de 5.000 millones de dólares de Venezuela a la directora del Fondo Monetario Internacional

El aeropuerto sobre la cordillera de los Andes que un país de Sudamérica moderniza con más de US$30 millones y estará listo en 2027

Recetas

Tallarines verdes peruanos: receta clásica deliciosa (VIDEO)

Cómo preparar un arroz con pollo tradicional riquísimo (VIDEO)

Sudado de pescado (VIDEO)

Escabeche de pollo receta: fácil y buenazo (VIDEO)

Ofertas

Cineplanet

CINEPLANET: 2 entradas 2D + 2 bebidas grandes + Pop corn gigante. Lunes a Domingo

PRECIO

S/ 47.90

La Bistecca

ALMUERZO O CENA BUFFET + Postre + 1 Ice tea de Hierba luisa en sus 4 LOCALES

PRECIO

S/ 85.90

Panini

PREVENTA: Álbum + paquetón Panini FIFA Mundial 2026 - DELIVERY GRATIS (Asegura tu pedido)

PRECIO

S/ 49.90

Flying Squirrel Parque de Inflables

FLYING SQUIRREL: 120 Minutos en Jockey Plaza, San Miguel e Independencia.

PRECIO

S/ 22.90