Los humanos prefieren oír las voces de robots que transmiten emociones complejas

Ingenieros electrónicos analizaron la reacción de las personas ante los sintetizadores de voz del Healthbot, robot sanitario con ajustes de empatía.

- El país de Sudamérica con el colibrí más hermoso del mundo: sus plumas cambian de color con la luz del sol

- Calendario lunar de abril 2024: ¿cuándo hay luna llena y en qué fase está el satélite?

La principal dificultad de la interrelación entre los humanos y los robots es que los autómatas nos conversan con voces sintetizadas carentes de verosimilitud; por ello, la confianza decae, sobre todo en adultos mayores.

Al respecto, un equipo de científicos integrado por Jesin James, del Centro de Ciencias de la Ingeniería Robótica y Automatización de la Universidad de Auckland (NCUK), en Nueva Zelanda, y sus colegas determinaron que la solución radica en dotar a las entidades mecánicas de una comunicación más compleja.

El estudio piloto fue publicado en la revista International Journal of Social Robotics con el título: Prueba y síntesis empática del habla para robots sanitarios. Dicho de otra forma, este artículo se enfoca principalmente en la creación de autómatas para la atención médica y su desarrollo empático con los pacientes u otros usuarios.

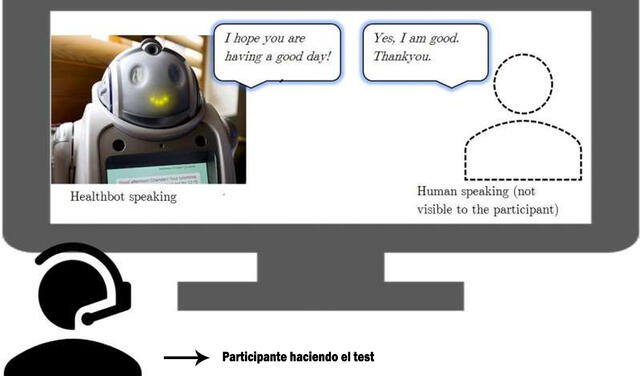

Para demostrar la hipótesis de que las voces de los robots afectan su entorno empático con los seres humanos, James y sus asociados utilizaron un Healthbot, mecanismo desarrollado por la Universidad de Auckland. El equipo de investigación consiguió 120 participantes, quienes se sometieron a una serie de pruebas.

Primero, le pidieron a un locutor profesional que haga una narración en dos registros: uno empático y otro plano. Luego, frente a la preferencia de las personas por la síntesis de voz con emociones, los involucrados en el estudio consensuaron que sería importante reproducir la técnica de tal profesional.

Empatía de robot. Un participante se somete a un experimento de percepción por parte de los investigadores | Imagen: James et al.

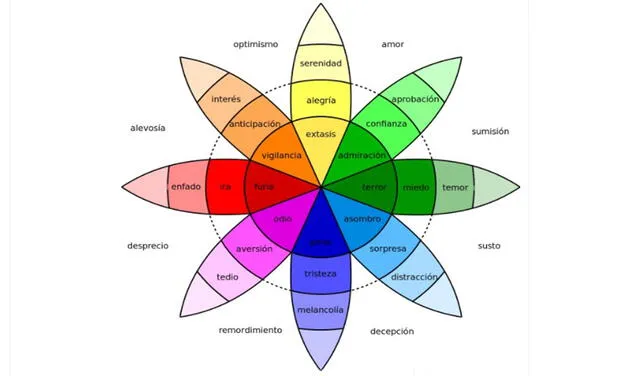

Sin embargo, eso no fue todo lo que observaron. También descubrieron que los usuarios humanos le daban mayor relevancia a las emociones secundarias (optimismo, remordimiento, culpa, orgullo, cinismo, envidia, entre otras) en comparación a las emociones primarias (alegría, confianza, tristeza, ira, etcétera).

Según el psicólogo Robert Plutchik (1927-2006), conocido por su Rueda de las Emociones, hay sentimientos que se transmiten por naturaleza y que son inherentes a la especie humana; incluso, se perciben de un recién nacido. Por otro lado, hay combinaciones de emociones que dan como resultado otras. Así, la suma del miedo y la sorpresa es la alarma; la tristeza y la anticipación generan pesimismo; y la sorpresa y la tristeza causan decepción.

James, a su vez, indicó que ampliar las capacidades del robot sanitario no sirve de nada si los usuarios se desaniman en interactuar cuando oyen una voz vacía. “Nuestro estudio reciente se basa en aproximadamente tres años de investigación”, precisó la científica.

Rueda de Plutchik. La aceptación de la compañía de un robot está relacionada con las emociones secundarias | Fotocaptura: madreshoy.com

Tras analizar el experimento piloto, el equipo apuntó cómo un modelo descriptivo con características distintivas de tonos de voz, inflexiones e intensidad puede modificar el paradigma del contacto de los robots con nosotros. En seguida, los científicos plantearon hacer escuchar a los voluntarios la nueva voz sintetizada.

“En esta segunda prueba de percepción, los participantes vieron un video del robot de atención médica hablando con la voz sintetizada y calificaron la empatía percibida en una escala de cinco puntos basada en el módulo Integridad del Tratamiento de Entrevistas Motivacionales (MITI)”, dijo James.

Hay que precisar que las 120 personas no vieron gestos faciales ni recibieron ayuda de ningún tipo, por lo que se extrajeron conclusiones despejadas de dudas.

“Estas emociones (secundarias) son de naturaleza sutil, pueden ser específicas de una cultura y, a veces, son difíciles de definir y reproducir, pero esta es la parte emocionante de analizarlas”, agregó la profesora en el Departamento de Ingeniería Eléctrica, Informática y de Software de la NCUK. Según ella, esta es la piedra inicial para montar y dar recursos a esta clase de investigación con nulos precedentes.

Jesin James espera realizar más pruebas de percepción usando videos de robots interrelacionándose con otros participantes “hasta que se sienten juntos”.

“No estamos exactamente seguros de lo que podríamos encontrar y eso lo hace aún más interesante”, puntualizó la experta.

En el artículo subido a International Journal of Social Robotics se señala: “El afecto es un concepto usado en psicología para describir la experiencia de un sentimiento o emoción. Aquí se explica la adición de emociones / sentimientos en el habla del robot”.

Como consecuencia, de acuerdo al punto 3 de las notas oficiales del estudio, habrá que trabajar en la computación afectiva, aquellos sistemas capaces de reconocer emociones y producirlas.

Investigación, últimas noticias:

Nuestro equipo de periodistas especializado en el campo de la ciencia redacta los artículos firmados por Ciencia LR. Cada publicación es revisada por nuestros editores para asegurar que cumpla con nuestra línea editorial y que es relevante para nuestras audiencias.