En contra de los robots asesinos

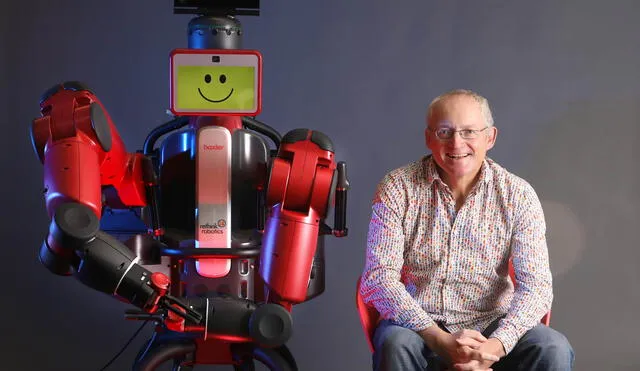

El científico australianoToby Walsh, lidera una campaña para detener el desarrollo de armas robóticas letales autónomas. “Un robot no puede decidir si un humano vive o muere”, dice.

Toby Walsh, profesor en la Universidad New South Wales en Sidney, y otros expertos han emitido un informe que detalla las posibilidades y los escollos de la adopción de la inteligencia artificial. Walsh, de 55 años, ha estado trabajando con la Campaña para Detener a los Robots Asesinos (Campaign to Stop Killer Robots), una coalición de científicos y líderes de DDHH que busca detener el desarrollo de armas robóticas autónomas.

-Eres científico e inventor. ¿Cómo te convertiste en activista de la lucha en contra de los robots asesinos?

A partir de 2013. Había estado leyendo sobre armas robóticas. Me di cuenta de que muy pocos colegas en el campo de la inteligencia artificial estaban pensando en los peligros de esta nueva clase de armas. Desestimaban a los robots asesinos como algo del futuro lejano. El futuro ya estaba aquí. Los bombarderos con drones estaban sobrevolando el cielo de Afganistán. Aunque los humanos los controlaban, basta una pequeña medida técnica para volverlos autónomos.

En 2015, durante una conferencia científica, organicé un debate sobre esta nueva clase de armas. Tiempo después, Max Tegmark, quien dirige el Instituto del Futuro de la Vida del Instituto Tecnológico de Massachusetts, me pidió que lo ayudara a divulgar una carta que hacía un llamado a la comunidad internacional para aprobar una prohibición preventiva contra todas las armas robóticas autónomas. Firmé la petición y, en la siguiente gran conferencia de inteligencia artificial, la divulgué. Para cuando terminó esa reunión, teníamos más de cinco mil firmas.

-¿Cuál era tu argumento?

Que no podemos permitir que las máquinas decidan si los humanos viven o mueren. Las máquinas no tienen nuestra brújula moral, nuestra compasión ni nuestras emociones. Las máquinas no son seres morales. Potencialmente se trata de armas de destrucción masiva y la comunidad internacional ha prohibido las demás armas de destrucción masiva.

Lo que hace distintas a estas armas de otras prohibidas previamente es su potencial de discriminación. Podrías indicarle: “Solo mata a niños”, y después agregar programas de reconocimiento facial al sistema.

-¿Por qué prohibir un arma antes de que se produzca?

El mejor momento para prohibir ese tipo de armas es antes de que estén disponibles. Es más difícil una vez que se vuelven una parte aceptada del conjunto de herramientas militares. El tratado sobre armas láser cegadoras de 1995 quizá es el mejor ejemplo de una prohibición preventiva exitosa.

-¿A quién va tu petición?

A la ONU. Siempre que voy, la gente parece estar dispuesta a escucharnos. Ni en sueños esperé sentarme con el subsecretario general de la ONU para darle un informe sobre esta tecnología. Un funcionario de la ONU me dijo: “Rara vez vemos que los científicos coinciden en la misma postura. Cuando eso sucede, los escuchamos”.

El parlamento europeo ha hecho un llamado a favor del asunto. ¡Son veintiocho países de doscientos! No es la mayoría.

-Los proponentes de las armas robóticas argumentan que, al limitar los combatientes humanos, las máquinas harían que los conflictos fueran menos mortíferos.

He escuchado esos argumentos. Algunos dicen que las máquinas podrían ser más éticas porque las personas en los conflictos hacen cosas terribles. Algunos simpatizantes de la tecnología esperan que eso no suceda si los robots libran las guerras, porque pueden programarse para apegarse a la ley humanitaria internacional. El problema es que no tenemos ninguna manera de programar algo tan sutil como la ley humanitaria internacional.

Hay algunas cosas para las que las fuerzas militares puedan utilizar la robótica. Para despejar un campo minado, por ejemplo. Si un robot estalla, puedes colocar otro en su lugar.

-Desde 2013, has estado invirtiendo tiempo en tu activismo y en tus investigaciones científicas. ¿Te arrepientes?

No. Es importante hacer esto ahora. Tengo una hija de 10 años. Cuando sea adulta, no quiero que me pregunte: “Papá, tenías una plataforma y autoridad. ¿Por qué no trataste de detener esta situación?”.

(Tomado de The New York Times)

Los artículos firmados por La República son redactados por nuestro equipo de periodistas. Estas publicaciones son revisadas por nuestros editores para asegurar que cada contenido cumpla con nuestra línea editorial y sea relevante para nuestras audiencias.