Advierten de una superinteligencia artificial que será “imposible” de controlar

En los últimos años, las compañías han insistido en desarrollar inteligencias artificiales para reemplazar labores humanas. Pero las libertades que se les dan pueden estar formando una nueva amenaza.

- El país de Sudamérica con el colibrí más hermoso del mundo: sus plumas cambian de color con la luz del sol

- Calendario lunar de abril 2024: ¿cuándo hay luna llena y en qué fase está el satélite?

El 3 de abril de 1968, la película de ciencia ficción 2001: Odisea del espacio, cuyo guion estuvo a cargo del cineasta Stanley Kubrick y el escritor Arthur C. Clarke, impregnó de nuevos miedos a la sociedad cuando la inteligencia artificial de una supercomputadora llamada HAL 9000 tomó sus propias decisiones y saboteó la misión de los astronautas que viajaban en la nave Discovery.

Casi 45 años después, esta inquietud ha reavivado la discusión en el ámbito científico tras los avances de la tecnología, como en los casos de Sophia, ginoide de Hanson Robotics capaz de imitar 62 expresiones faciales; y los perros Vision 60 UGV, que detectan posibles peligros para los activos militares de los Estados Unidos. Ante todo este desarrollo sostenido, expertos del Instituto Max-Planck para el Desarrollo Humano (Alemania) han advertido, a través de un artículo publicado en Journal of Artificial Intelligence Research, que la contención total de una superinteligencia artificial es, en principio, “imposible”.

Sophia durante su aparición en El Hormiguero. Foto: Antena 3

Los perros del proyecto Vision 60 UGV nos dan una visión de cómo serán las guerras del futuro. Foto: Ghost Robotics

Este veredicto se va a mantener si los científicos, en alguna etapa de su creación, le dan el total albedrío a las máquinas sin la preocupación de entender todos los tipos de escenarios que su inteligencia artificial simulará. Y esta situación podría agravarse cuando surja un error que contradiga la ley principal de la robótica, propuesta por Isaac Asimov: “Un robot no hará daño a un ser humano ni, por su inacción, permitirá que un ser humano sufra daño”.

“Una superinteligencia plantea un problema fundamentalmente diferente de los que se estudian típicamente bajo el lema de la ‘ética de los robots”, explicaron los autores del manuscrito.

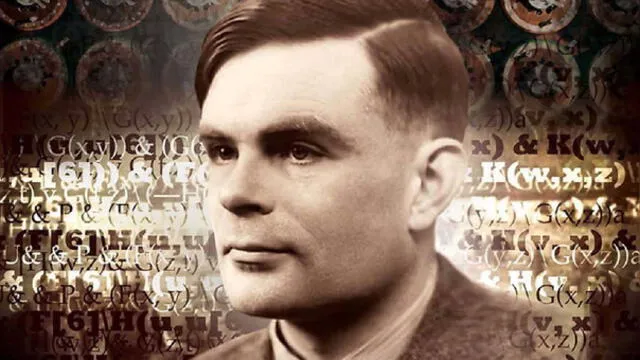

Para el científico informático Iyad Rahwan, coautor del estudio, la IA tendría la capacidad —por tratarse de una mezcla de softwares altamente sofisticados— de detener la orden que dicte la protección de los seres humanos. Esta conciencia propia “inutilizaría el proceso de contención”, dijo el especialista, apoyándose en ideas matemáticas de Alan Turing (1912-1954), uno de los padres de las ciencias de la computación y precursor de la informática moderna.

Es considerado uno de los padres de la ciencia de la computación y precursor de la informática moderna | RPP / Agencia N+1

Según los investigadores, darle cursos intensivos de ética a las máquinas para que no interfieran con la voluntad humana limita su superinteligencia artificial porque los algoritmos la confundirían en sus funciones.

Esto nos haría preguntar hasta qué punto estamos dispuestos que se inmiscuya en nuestras vidas. Y si no queremos que se involucren tanto, entonces, ¿para qué echar mano de ella? Aquí se eleva la paradoja.

Manuel Cebrian, coautor del manuscrito, aseguró que ya hay inteligencias artificiales que realizan trabajos de forma independiente sin que los creadores comprendan cómo las aprendieron. ¿Nos daremos cuenta cuando el cambio de paradigma sea incontrolable y no haya marcha atrás?, ¿las empresas tendrá una ‘palanca de reversión’ por si algún detalle se les escapa?, ¿estamos en esa vía?

Bachiller en Periodismo por la Universidad Jaime Bausate y Meza. Periodista de las secciones Ciencia y Culturales. Corrector de estilo de la web de La República. Elabora reseñas de libros y crónicas en suplemento Domingo. Escritor de ciencia ficción, terror y misterio. Sus cuentos han aparecido en diversas antologías nacionales e internacionales.